2 sierpnia 2026 wejdzie w życie większość przepisów unijnego AI Act – pierwszego na świecie tak złożonego prawa, mającego uregulować zastosowanie narzędzi opartych na sztucznej inteligencji. Firmy, które już zdążyły włączyć AI do swoich procesów biznesowych – albo dopiero to planują – muszą być na to gotowe… zwłaszcza jeśli korzystają z autonomicznych agentów. Jak podchodzą do nich nowe regulacje AI i jakie znaczenie dla biznesu ma AI Act? O tym poniżej.

Dlaczego Europa reguluje AI? Fundamenty i cele AI Act

Poziom, na jakim narzędzia AI potrafią w tym momencie przetwarzać duże ilości danych, jest nieporównywalny z jakąkolwiek inną formą oprogramowania. Coraz częściej są też w stanie w zasadzie samodzielnie – przy minimalnym udziale człowieka – podejmować decyzje i całe sekwencje działań na podstawie analizy tych danych. To tworzy ogromne pole do nadużyć, dlatego Unia Europejska przez ostatnie lata intensywnie pracowała nad regulacją prawną AI oraz całego rynku, który wokół niej powstał.

AI Act został opublikowany w Dzienniku Urzędowym Unii Europejskiej w lipcu 2024, a wszedł w życie miesiąc później. Część przepisów – tych, które dotyczą systemów potencjalnie najbardziej niebezpiecznych dla praw obywateli krajów UE – zaczęła obowiązywać już w lutym 2025 roku. Natomiast większość regulacji wejdzie w życie 2 sierpnia 2026.

Przepisy będą obejmować każdą firmę, która tworzy, wdraża lub wykorzystuje systemy AI na terenie UE – niezależnie od tego, czy ma siedzibę w Europie, czy nie. To oznacza, że będą musieli się dostosować do nich również giganci z USA, z OpenAI, Google oraz Anthropic na czele. Tak więc wpływ AI Act na rynek i, ogólnie, na przyszłość sztucznej inteligencji, prawdopodobnie będzie ogromny, nie tylko w Europie.

Całemu rozporządzeniu przyświecają trzy główne cele.

- Ochrona praw podstawowych – żeby systemy AI nie dyskryminowały, nie manipulowały i nie naruszały prywatności mieszkańców UE.

- Przejrzystość – użytkownicy mają zawsze prawo wiedzieć, kiedy mają do czynienia ze sztuczną inteligencją.

- Odpowiedzialność – ktoś musi być prawnie odpowiedzialny za decyzje podejmowane przez AI.

Oczywiście, narzędzie narzędziu nierówne. Zamiast narzucać jednolite zasady dla wszystkich, AI Act dzieli systemy sztucznej inteligencji na cztery poziomy ryzyka. Im wyższy stopień, tym bardziej rygorystyczne wymagania.

| Poziom ryzyka | Jakich rozwiązań dotyczy? | Przykłady zastosowania AI w firmach |

|---|---|---|

| Niedopuszczalne | Systemy, które naruszają podstawowe prawa, manipulują ludźmi bez ich wiedzy lub mogą służyć do inwigilacji. | Narzędzia do manipulacji podprogowych, które wywołują szkody fizyczne lub psychiczne; systemy typu social scoring czy biometryczna kategoryzacja wrażliwych danych (np. przekonań politycznych). |

| Wysokie | Systemy, które samodzielnie podejmują lub wspierają decyzje mające istotny wpływ na życie ludzi. | Narzędzia do automatycznego selekcjonowania CV i oceny kandydatów, systemy scoringu kredytowego. |

| Ograniczone | Systemy, które wchodzą w interakcje z ludźmi lub generują treści. | Chatboty obsługi klienta, modele generatywne. |

| Minimalne | Systemy, których wpływ na prawa i bezpieczeństwo użytkowników jest znikomy. | Filtry antyspamowe, narzędzia do rekomendacji treści i produktów. |

Od czatów do pracowników cyfrowych: fenomen autonomicznych agentów

Ogromna większość narzędzi, z których na co dzień korzystają firmy, zalicza się na razie do kategorii minimalnego, ewentualnie ograniczonego ryzyka. Jednak autonomiczni agenci AI trochę tę kwestię komplikują.

Dlaczego? Przejdźmy w telegraficznym skrócie przez „ewolucję” biznesowych narzędzi opartych na sztucznej inteligencji.

Na początku mieliśmy chatboty – duże modele językowe dostępne przez interfejs czatu, takie jak ChatGPT czy Gemini. Działają one w prosty sposób: użytkownik wpisuje pytanie lub zadanie, a model generuje odpowiedź.

Szybko zaczęto też integrować modele językowe z innymi narzędziami – idealnym przykładem może być Copilot od Microsoftu, z którego możesz korzystać w praktycznie wszystkich aplikacjach dawnego Office’a. Pracują one tak samo, jak chatboty, ale mają już dostęp do większej ilości danych.

A potem pojawili się agenci AI. To aplikacje nadal oparte na LLM-ach, ale zdolne do samodzielnego wykonywania całych sekwencji działań potrzebnych do osiągnięcia jakiegoś celu. Mają dostęp do zewnętrznych narzędzi: mogą przeszukiwać internet, odczytywać i zapisywać dane w podłączonych do nich platformach, wysyłać zapytania do API, a nawet zlecać zadania innym agentom.

Problem jest więc taki: agenci nie dość, że mogą zarządzać danymi w podpiętych systemach, to jeszcze robią to samodzielnie, a nie tylko „na prompt” użytkownika. I oczywiście, to człowiek decyduje, do jakich danych agent ma dostęp i programuje jego sekwencję działań… ale odpowiedzialność za jego pracę zaczyna się rozmywać.

Implementacja w praktyce: agenci w służbie SEO i marketingu

Pokażemy na przykładzie, jak może wyglądać zastosowanie autonomicznych systemów w biznesie.

Wyobraźmy sobie agencję SEO z kilkunastoma stałymi klientami. Każdy z nich ma swoją domenę, profil linkowy, historię w Google Search Console i zestaw fraz kluczowych, które trzeba monitorować. Śledzeniem i analizą wszystkich tych danych może zająć się specjalista SEO, tyle że to wymaga długich godzin pracy w Ahrefs, narzędziach od Google itd. Można też tak zaplanować przepływ pracy, aby monitorowaniem danych zajął się agent AI, a specjaliście pozostało podejmowanie decyzji, jakie działania podjąć na stronie, aby poprawić jej pozycję w wyszukiwarkach. Mogłoby to wyglądać tak:

- Agent podłączony do GSC i Screaming Frog w określonych odstępach czasu sprawdza kondycję domeny – czy pojawiają się błędy indeksowania, problemy z przekierowaniami, jak wyglądają wskaźniki Core Web Vitals. Jeśli coś się wydarzy niepokojącego, automatycznie generuje raport i przekazuje go specjaliście.

- Na tej samej zasadzie – jeśli podepniemy go pod Ahrefs czy Semrush, może monitorować zmiany w wynikach wyszukiwania pod najważniejszymi dla strony frazami. A do tego, na przykład, identyfikować frazy, pod którymi domena pozycjonuje się blisko pierwszej strony SERP-ów i co tydzień wysyłać raport z listą słów o największym potencjale.

- Albo, jeśli agencja wystarczająco ufa LLM-owi, na którym bazuje agent, może go nawet połączyć z CMS-em witryny i pozwolić samodzielnie edytować metadane dla wszystkich podstron na podstawie analizy, jak wyglądają one na stronach z TOP 10 wyników wyszukiwania.

Możliwości jest wiele. Najważniejsze pytanie w kontekście bezpieczeństwa AI i nowych przepisów dotyczących sztucznej inteligencji brzmi jednak tak:

Czy agent służy tylko do analizy danych oraz generowania wskazówek dla specjalistów, czy ma też uprawnienia, aby samodzielnie, bez udziału człowieka, podejmować działania na danych, do których ma dostęp?

Wyzwania dla managerów: compliance, etyka i dane

Z treści europejskiego AI Act wynikają trzy duże wyzwania, z którymi każda firma musi się zmierzyć – najlepiej już teraz, zanim wszystkie przepisy wejdą w życie.

Po pierwsze, w jaki sposób spełni zasadę przejrzystości? Tak jak powiedzieliśmy na samym początku, w duchu nowych przepisów użytkownicy będą musieli wiedzieć, kiedy po drugiej stronie ekranu znajduje się AI, a nie człowiek. Dotyczy to oczywiście chatbotów i voicebotów, ale też treści stworzonych w całości przez modele generatywne (!).

Po drugie – jak zarządzać danymi, które udostępniamy modelom AI? W tej kwestii AI Act idzie w parze z RODO. Jeśli skupiamy się tylko na agentach – pamiętaj, że podłączając go do CRM-u czy bazy mailingowej, dajesz mu dostęp do wrażliwych danych osobowych i finansowych, a być może nawet do informacji objętych tajemnicą handlową.

I ostatnia kwestia: kto bierze odpowiedzialność za działania agentów AI? Przepisy wymagają, aby każdy autonomiczny system – zwłaszcza jeśli zalicza się do tych wysokiego ryzyka – działał zgodnie z zasadą human oversight. Czyli żeby na każdym etapie pracy takiego systemu człowiek mógł go nadzorować i, w razie potrzeby, interweniować.

W przypadku typowych zastosowań sztucznej inteligencji w biznesie te trzy kwestie są najważniejsze. Natomiast im większą rolę agenci AI odgrywają w Twoich procesach biznesowych, tym wyzwań będzie, siłą rzeczy, więcej. Wszystkiego o nowych przepisach możesz dowiedzieć się z treści samego AI Act (znajdziesz je jako rozporządzenie 2024/1689) albo ze specjalnie przygotowanej strony internetowej dla organizacji pracujących z AI – artificialintelligenceact.eu.

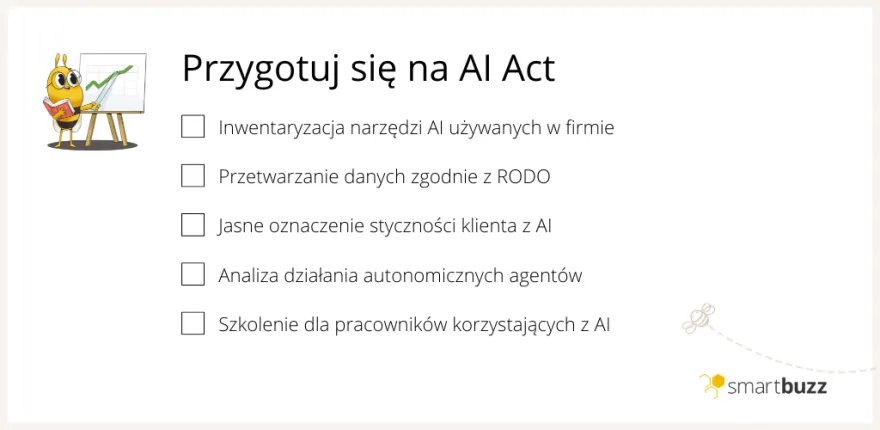

My zaś, na koniec, przygotowaliśmy krótką checklistę, która pomoże Ci przygotować firmę na AI Act.

- Przeprowadź „inwentaryzację” wszystkich systemów AI używanych w firmie – zarówno tych wdrożonych przez dział IT, jak i tych, z których korzystają pracownicy na własną rękę.

- Sprawdź, czy dostawcy używanych przez Ciebie narzędzi AI przetwarzają dane zgodnie z RODO: gdzie i jak długo są przechowywane, czy są używane do trenowania modeli oraz czy można je usunąć na żądanie.

- Sprawdź wszystkie punkty styku klienta z firmą, na których klient ma kontakt z AI lub generowanymi przez nią treściami – muszą być one jasno oznaczone.

- Dokładnie przeanalizuj działanie autonomicznych agentów AI, jeśli z nich korzystasz: do jakich narzędzi i danych mają dostęp, w jakim zakresie mogą podejmować działania oraz gdzie w ich procesie pracy jest miejsce dla człowieka.

- Przeprowadź szkolenie dla pracowników korzystających z narzędzi AI – o tym, jakie dane można wprowadzać do modeli językowych, powinni wiedzieć nie tylko prawnicy.

FAQ

Co to jest Akt o sztucznej inteligencji (AI Act) i kogo dotyczy?

AI Act to rozporządzenie Unii Europejskiej, które weszło w życie w sierpniu 2024 roku i reguluje zasady korzystania z systemów sztucznej inteligencji. Obejmuje wszystkie firmy, które rozwijają, wdrażają lub użytkują systemy AI na terenie UE.

Od kiedy obowiązuje Akt o sztucznej inteligencji w Polsce?

Czym różni się autonomiczny agent AI od tradycyjnego chatbota?

Czy używanie autonomicznych agentów w marketingu jest legalne?

Czy muszę informować użytkowników, że na mojej stronie działają agenci AI?

Źródła:

https://www.artificialintelligenceact.eu

https://www.eur-lex.europa.eu/eli/reg/2024/1689/oj/eng

https://www.digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

https://www.deloitte.com/pl/pl/Industries/financial-services/perspectives/AI-Act-Co-tak-naprawde-zmienia-i-czy-ogranicza-swobode-korzystania-z-system-w-AI

Zapisz się do darmowego newslettera

Zyskaj dodatkową wiedzę o SEO, marketingu i technologiach.